Il libro di fisica (The Intelligent Man’s Guide to Science) è un saggio di Isaac Asimov pubblicato per la prima volta nel 1960. Ha avuto varie riedizioni, nelle quali il contenuto è stato rivisto. Venne ripubblicato nel 1964 come The New Intelligent Man’s Guide to Science, nel 1972 come Asimov’s Guide to Science e nel 1984 come Asimov’s New Guide to Science. È diventato un libro scolastico negli Stati Uniti, per la sua qualità di esposizione.

Il libro è strutturato in dieci capitoli e analizza diverse branche della fisica, in particolare l’astrofisica e la fisica nucleare.

Vi propongo in seguito il capitolo L’ATMOSFERA.

Asimo non solo spiega gli strati dell’involucro vivente della Terra, ma racconta anche uno degli esperimenti più incredibili fatti negli anni Cinquanta, ovvero quello di creare un anello di aghi intorno al pianeta. Asimov tocca anche il tema della manipolazione meteorologica.

È un capitolo fondamentale che non può mancare nell’archivio di questo blog.

L’ATMOSFERA – GLI INVOLUCRI DI ARIA

Aristotele supponeva che il mondo fosse fatto di quattro involucri sferici, ciascuno costituito di uno dei quattro elementi della materia: terra (la sfera solida), acqua (l’oceano), aria (l’atmosfera) e fuoco (una sfera esterna invisibile, che diventava occasionalmente visibile nel bagliore dei lampi). Egli sosteneva inoltre che all’esterno di queste sfere l’universo fosse composto di un quinto elemento perfetto, non terrestre, che chiamò “etere” (detto poi, in latino, “quinta essentia”, letteralmente «quinto elemento»).

In questo schema non c’era posto per il vuoto: dove finiva la terra, cominciava l’acqua; dove finivano entrambe, cominciava l’aria; dove finiva l’aria, cominciava il fuoco; e dove finiva il fuoco, cominciava l’etere, che continuava fino al confine dell’universo. «La natura,» dicevano gli antichi, «ha orrore del vuoto.»

Misure dell’atmosfera

La pompa aspirante, un’invenzione utilizzata fin dall’antichità per estrarre l’acqua dai pozzi, sembrava illustrare in modo mirabile questo orrore del vuoto. Uno stantuffo scorre entro un cilindro aderendo ermeticamente alle sue pareti; quando si spinge verso il basso la leva della pompa, lo stantuffo viene tirato verso l’alto, e lascia uno spazio vuoto nella parte inferiore del cilindro. Ma siccome la natura aborre il vuoto, l’acqua che circonda la base del cilindro fa aprire una valvola a senso unico posta sul fondo del cilindro stesso, e irrompe nello spazio vuoto. Ripetendo più volte l’operazione, l’acqua sale sempre di più nel cilindro, fino a traboccare dal becco della pompa.

Secondo la teoria aristotelica, questo sistema avrebbe dovuto consentire di innalzare l’acqua fino a qualsiasi altezza. Ma i minatori, che dovevano pompare l’acqua verso l’alto sgombrando il fondo delle miniere, scoprirono che non era possibile sollevare l’acqua per più di dieci metri sopra il suo livello iniziale, per quanto si pompasse con forza e a lungo.

Galileo si interessò molto a questo problema verso la fine della sua lunga vita di ricercatore. Non riuscì a raggiungere alcuna conclusione, salvo quella che, a quanto pare, la natura aborre il vuoto solo fino a un certo limite; egli si chiese se questo limite sarebbe stato inferiore usando un liquido più denso dell’acqua, ma morì prima di aver potuto effettuare questo esperimento. I suoi discepoli Evangelista Torricelli e Vincenzo Viviani effettuarono l’esperimento nel 1644. Scelsero il mercurio, che ha una densità 13,5 volte maggiore di quella dell’acqua, riempirono con tale liquido un tubo di vetro lungo un metro, tapparono l’estremità aperta del tubo, lo capovolsero in una vaschetta piena di mercurio e tolsero il tappo. Il mercurio cominciò a defluire dal tubo nella vaschetta, ma, quando il suo livello raggiunse i 76 centimetri sopra il livello del mercurio nella vaschetta, esso smise di uscire dal tubo e si arrestò.

Era stato così realizzato il primo “barometro”; i moderni barometri a mercurio non sono sostanzialmente diversi. Non ci volle molto perché si comprendesse che l’altezza della colonna di mercurio non era sempre identica. Lo scienziato inglese Robert Hooke osservò, dopo il 1660, che l’altezza della colonna di mercurio diminuiva prima dei temporali, aprendo così la via alla previsione scientifica del tempo, cioè alla “meteorologia”.

Ma che cosa impediva al mercurio di scendere? Viviani ipotizzò che fosse il peso dell’atmosfera, che premeva sul liquido nella vaschetta. Era un’idea rivoluzionaria, perché secondo la concezione aristotelica l’aria non aveva peso, essendo attratta solo dalla propria sfera, al di sopra della terra. Ora, invece, risultava evidente che una colonna di acqua dell’altezza di dieci metri, o una colonna di mercurio di 76 centimetri, misuravano il peso dell’atmosfera – cioè il peso di una colonna di aria di pari sezione, che dal livello del mare si elevasse fin dove giunge l’atmosfera.

L’esperimento dimostrava anche che non necessariamente la natura aborre dal vuoto in tutte le circostanze. Lo spazio che restava nell’estremo chiuso del tubo dopo la caduta del mercurio era vuoto, non contenendo altro che una quantità piccolissima di vapore di mercurio; questo “vuoto torricelliano” fu il primo vuoto prodotto artificialmente.

Il vuoto fu messo quasi immediatamente al servizio della scienza. Nel 1650 lo studioso tedesco Athanasius Kircher dimostrò che il suono non si propaga nel vuoto, confermando, una volta tanto, un’affermazione di Aristotele. Nel decennio successivo Robert Boyle mostrò che oggetti molto leggeri cadevano nel vuoto con la stessa velocità degli oggetti pesanti, confermando in tal modo le teorie di Galileo sul moto (contro quelle di Aristotele).

Se l’aria aveva un peso finito, doveva avere anche un’altezza finita. Risultò che il peso dell’atmosfera era di 1,033 chilogrammi per centimetro quadrato; in base a questo dato, si poté calcolare che l’atmosfera doveva essere alta solo otto chilometri circa – sempre che la sua densità restasse invariata per tutta la sua altezza. Nel 1662, però, Boyle dimostrò che questo era impossibile, perché la densità dell’aria cresceva con la pressione. Boyle prese un tubo a forma di J [i lunga] e, tenendolo verticale, versò del mercurio nell’imboccatura, all’estremità del ramo più lungo; il mercurio intrappolò un po’ d’aria nell’estremo chiuso del ramo corto del tubo; versando altro mercurio, la sacca di aria si restringeva, e al tempo stesso la sua pressione aumentava, come Boyle dedusse dal fatto che la contrazione diminuiva via via che aumentava il peso del mercurio. Effettuando misurazioni accurate, Boyle dimostrò che, riducendo a metà il volume del gas, la sua pressione raddoppiava; in altre parole, il volume variava in modo inversamente proporzionale alla pressione. Questa storica scoperta, nota come “legge di Boyle”, costituì il primo passo nella lunga serie di scoperte sulla materia, che finirono per portare alla teoria atomica.

Se l’aria diminuisce di volume per effetto della pressione, deve essere più densa a livello del mare, rarefacendosi gradualmente al diminuire del peso dell’aria sovrastante, via via che ci si innalza verso gli strati superiori dell’atmosfera. Questo fatto fu dimostrato per la prima volta nel 1648 dal matematico francese Blaise Pascal, che fece salire su una montagna alta circa 1500 metri il cognato Florin Perier, munito di un barometro, perché osservasse di quanto calava il livello del mercurio al crescere dell’altitudine.

Calcoli teorici mostrarono che, nell’ipotesi di una temperatura costante alle varie quote, la pressione dell’aria diminuirebbe di dieci volte ogni 20 chilometri di altitudine in più. In altri termini, a 20 chilometri di quota la colonna di mercurio controbilanciata dall’aria passerebbe da 76 a 7,6 centimetri; a 40 chilometri sarebbe di 0,76 centimetri, a 60 chilometri di 0,076 centimetri, e così via. A un’altitudine di 180 chilometri, la pressione dell’aria sarebbe pari a soli 0,000000076 centimetri di mercurio. Può sembrare assai poco, ma il peso globale dell’aria al di sopra dei 180 chilometri di altitudine sarebbe ancora di 5,5 milioni di tonnellate.

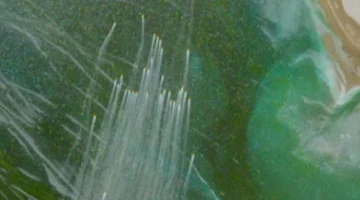

In realtà tutte queste cifre non sono che approssimazioni, perché la temperatura dell’aria varia con l’altitudine. Tuttavia questi dati forniscono un’idea generale della situazione, mostrandoci cheù l’atmosfera non ha un limite netto, ma si rarefà gradualmente dissolvendosi nel vuoto dello spazio. Scie di meteoriti sono state osservate perfino alla quota di 160 chilometri, dove l’aria ha una pressione che è solo un milionesimo di quella che ha alla superficie della terra e una densità che è solo un miliardesimo. Eppure è quanto basta per portare all’incandescenza questi minuscoli frammenti di materia, riscaldati dalla resistenza dell’aria. Quanto poi alle aurore boreali, che sono formate da filamenti di gas resi luminosi dal bombardamento di particelle provenienti dallo spazio esterno, esse vengono localizzate fra gli 800 e i 1000 chilometri sopra il livello del mare.

VIAGGI NELL’ARIA

Fin dai tempi più antichi, sembra che gli uomini abbiano sempre desiderato ossessivamente di viaggiare nell’aria. Il vento può far volare oggetti leggeri – come le foglie, le piume, i semi. Più

suggestivo è il volo planato di animali come gli scoiattoli volanti, i falangisti volanti e perfino i pesci volanti; ma naturalmente di gran lunga più appariscenti sono gli animali capaci di volare veramente: insetti, pipistrelli, uccelli. Dell’aspirazione degli esseri umani a seguire tali esempi è rimasta traccia nei miti e nelle leggende. Gli dei e i demoni sono normalmente in grado di viaggiare via aria (angeli e fate sono sempre rappresentati con le ali); vi è poi la leggenda di Icaro, da cui ha preso il nome un asteroide (vedi capitolo terzo), nonché quella del cavallo volante, Pegaso, per non parlare dei tappeti volanti delle leggende orientali.

Il primo congegno artificiale in grado, se non altro, di librarsi ad altezze notevoli per un tempo considerevole fu l’aquilone, un foglio di carta, o di un materiale analogo, teso su una leggera intelaiatura di legno, munito di una coda per garantire la stabilità e di una lunga corda con cui tenerlo. Si dice che a inventarlo sia stato il filosofo greco Archita, nel quarto secolo avanti Cristo.

Gli aquiloni sono stati usati per migliaia di anni, soprattutto per divertimento, anche se non mancano possibilità di utilizzazione pratica: è possibile appendervi segnali luminosi in modo che siano visibili da una vasta area, oppure si possono sfruttare per far passare da una parte all’altra di un fiume o di un burrone una leggera corda, che poi servirà a tendere cavi più grossi, consentendo la costruzione di un ponte.

Il primo tentativo di usare un aquilone (o cervo volante) per fini scientifici fu fatto nel 1749, quando un astronomo scozzese, Alexander Wilson, vi attaccò dei termometri, con la speranza di misurare la temperatura in quota. Molto più importante fu l’aquilone fatto innalzare da Benjamin Franklin nel 1752, su cui tornerò nel capitolo nono.

I cervi volanti (o analoghi marchingegni capaci di librarsi nell’aria) non diventarono abbastanza grandi e robusti da poter trasportare persone per altri centocinquanta anni, ma il problema fu risolto altrimenti durante la vita di Franklin. Nel 1782 due fratelli francesi, Joseph Michael e Jacques Etienne Montgolfier, accesero un fuoco sotto a un grande involucro fornito di un’apertura nella parte inferiore, in modo da riempire l’involucro stesso di aria calda, con l’effetto di farlo lentamente sollevare. I fratelli Montgolfier avevano così lanciato con successo il primo pallone. Nel giro di pochi mesi, i palloni cominciarono a essere riempiti di idrogeno, un gas con densità pari a un quattordicesimo della densità dell’aria, così che ogni chilogrammo d’idrogeno era in grado di sollevare un carico utile di 13 chilogrammi. Sulle navicelle dei palloni vennero fatti salire animali, e poco dopo anche uomini.

Prima che fosse trascorso un anno dal lancio del primo pallone, un americano, John Jeffries, compì un volo su Londra con a bordo un barometro e altri strumenti, tra cui un dispositivo per raccogliere l’aria a varie altezze. Nel 1804 lo scienziato francese Joseph Louis Gay-Lussac salì fino a un’altezza di oltre 7000 metri, riportando poi a terra campioni di aria rarefatta. Queste imprese avventurose divennero un po’ più sicure quando l’aeronauta francese Jean Pierre Blanchard, nel 1785, ancora all’alba dell'”età del pallone”, inventò il paracadute.

Si era comunque quasi raggiunto il limite a cui potevano spingersi degli esseri umani in una navicella aperta: nel 1875 tre uomini salirono a quasi 10 mila metri, ma solo uno di loro, Gaston Tissandier, sopravvisse alla scarsezza di ossigeno, e poté descrivere i sintomi della mancanza di aria: era nata così la “medicina aeronautica”. Palloni senza uomini a bordo, ma muniti di strumenti, vennero ideati e lanciati nel 1892; in questo caso era possibile infatti mandarli ancora più in alto, ottenendone poi informazioni sulla temperatura e la pressione di regioni dell’atmosfera fino ad allora inesplorate.

Nei primi chilometri di ascesa, la temperatura diminuiva, come previsto. A circa 11 chilometri era di meno 55 gradi C. Ma ecco una sorpresa: al di sopra di questo livello, la temperatura non diminuiva più, anzi aumentava leggermente. Il meteorologo francese Léon Philippe Teisserenc de Bort, nel 1902, avanzò l’ipotesi che l’atmosfera potesse consistere di due strati: uno inferiore turbolento, sede di nuvole, venti, tempeste, e di tutti gli altri ben noti fenomeni atmosferici (nel 1908, egli denominò questo strato “troposfera”, da una parola greca che significa: sfera dei

cambiamenti); e uno strato superiore più tranquillo, formato da sottostrati dei gas più leggeri, elio e idrogeno (che denominò appunto “stratosfera”). Teisserenc de Bort chiamò il livello in cui cessava la diminuzione della temperatura “tropopausa” (fine dei cambiamenti); essa segna il confine tra troposfera e stratosfera. La tropopausa, com’è risultato in seguito, varia da un’altitudine di circa 16 chilometri sul livello del mare, all’equatore, a soli 8 chilometri al di sopra dei poli.

Durante la seconda guerra mondiale alcuni piloti di bombardieri americani che volavano ad alta quota scoprirono, subito al di sotto della tropopausa, un fenomeno eclatante: la “corrente a getto”, cioè un vento costante, fortissimo, diretto da ovest a est, con velocità fino a 800 chilometri all’ora. In realtà vi sono due correnti a getto, una nell’emisfero settentrionale, alla latitudine degli Stati Uniti, del Mediterraneo e della Cina settentrionale, l’altra nell’emisfero meridionale, alla latitudine della Nuova Zelanda e dell’Argentina. Le correnti hanno un andamento serpeggiante, e danno spesso origine a vortici, molto a nord o a sud del loro corso abituale. Oggi gli aerei approfittano di queste rapide correnti d’aria. Ma molto più importante è la scoperta che le correnti a getto hanno una grandissima influenza sul movimento delle masse d’aria a livelli inferiori, una conoscenza questa che contribuì immediatamente a migliorare le previsioni meteorologiche.

Dato che gli esseri umani non possono sopravvivere nell’atmosfera fredda e rarefatta delle grandi altezze, si rese necessario realizzare cabine a tenuta ermetica, entro le quali si potessero mantenere le pressioni e le temperature che ha l’aria alla superficie della terra.

Così, nel 1931, i fratelli Piccard (Auguste e Jean Félix), il primo dei quali doveva più tardi inventare il batiscafo, salirono fino a 18 mila metri con un pallone a cui era attaccata una navicella chiusa ermeticamente. Poi nuovi palloni di materiale plastico, più leggero e meno poroso della seta, consentirono di salire più in alto e di rimanervi più a lungo. Nel 1938 un pallone denominato “Explorer Secondo” si spinse fino a 21 chilometri di altezza e, durante gli anni ottanta, palloni con uomini a bordo hanno raggiunto i 38 chilometri, mentre palloni senza equipaggio hanno superato addirittura i 50 chilometri. Questi voli a quote superiori hanno mostrato che la zona a temperatura quasi costante non si estende indefinitamente verso l’alto. La stratosfera finisce a un’altezza di circa 32 chilometri, e più in alto la temperatura comincia ad aumentare!

In questa “atmosfera superiore” (al di sopra della stratosfera), che contiene solo il 2 per cento della massa di aria totale della terra, fu possibile penetrare negli anni quaranta, quando ulteriori progressi tecnologici misero a disposizione un tipo di veicolo completamente nuovo, il razzo (vedi capitolo terzo).

Il modo più diretto di leggere le misure degli strumenti che hanno registrato le condizioni dell’aria a grandi altitudini, consiste nel far tornare tali strumenti a terra. E’ facile riportare a terra gli strumenti portati in alto da aquiloni, mentre i palloni sotto questo aspetto offrono maggiori difficoltà e i razzi, poi, possono anche non ritornare affatto a terra. Naturalmente, è possibile fare in modo che il razzo espella un contenitore con gli strumenti, che ritorneranno a terra da soli, ma anche questo metodo non è molto affidabile. I soli razzi, in pratica, avrebbero contribuito assai poco all’esplorazione dell’atmosfera, se non fosse stato per un’invenzione concomitante – la trasmissione delle misure a distanza (“telemisura”). Essa fu applicata per la prima volta a un pallone per la ricerca sull’atmosfera nel 1925, da parte dello scienziato russo P. A. Molchanoff.

Sostanzialmente, la tecnica della telemisura si basa sulla traduzione delle condizioni che si vogliono misurare (per esempio, la temperatura) in impulsi elettrici, che sono trasmessi a terra via radio. Le osservazioni prendono la forma di cambiamenti di intensità degli impulsi o di intervallo tra un impulso e l’altro. Per esempio, un cambiamento di temperatura fa variare la resistenza elettrica di un conduttore, cambiando in tal modo la natura dell’impulso; una variazione della pressione atmosferica, analogamente, si traduce in un dato impulso per il fatto che l’aria raffredda il conduttore, e l’entità di tale raffreddamento dipende dalla pressione; la radiazione suscita impulsi in un rivelatore, e così via.

Oggigiorno la telemisura è diventata talmente sofisticata che ai razzi sembra mancare quasi

soltanto la parola: i loro complessi messaggi debbono essere interpretati da computer veloci. I razzi e la telemisura hanno dunque mostrato che al di sopra della stratosfera la temperatura sale fino a un massimo di circa meno 10 gradi C all’altezza di 48 chilometri e poi scende nuovamente fino a un minimo di meno 90 gradi C all’altezza di 80 chilometri. Questa regione in cui la temperatura prima sale e poi scende viene chiamata “mesosfera”, termine coniato nel 1950 dal geofisico inglese Sydney Chapman. La poca aria che si trova al di là della mesosfera non costituisce più di qualche millesimo dell’1 per cento della massa totale dell’atmosfera. Ma la temperatura di questi atomi dispersi aumenta costantemente, fino a un valore che si stima raggiunga i 1000 gradi C a 480 chilometri di altezza, e probabilmente raggiunge valori ancora più elevati salendo ulteriormente; pertanto questo strato viene chiamato “termosfera” («sfera del calore») – il che riecheggia stranamente la sfera del fuoco di Aristotele. Naturalmente, qui la temperatura non va associata al calore nel senso abituale: si tratta solo di una misura della velocità delle particelle.

Al di sopra dei 480 chilometri incomincia l'”esosfera” (termine usato per la prima volta da Lyman Spitzer nel 1949), che può estendersi fino a 1600 chilometri di altezza, per poi sfumare gradualmente nello spazio interplanetario. Se avremo una conoscenza più approfondita dell’atmosfera potremo, in futuro, intervenire sul clima anziché limitarci a farne argomento di conversazione. Già sono stati compiuti alcuni passi in tal senso. All’inizio degli anni quaranta, i chimici americani Vincent Joseph Schaefer e Irving Langmuir avevano osservato che temperature molto basse potevano produrre i nuclei di condensazione necessari per la formazione delle gocce di pioggia. Nel 1946 un aereo lasciò cadere dell’anidride carbonica in polvere su un banco di nubi allo scopo di formare i nuclei di condensazione e quindi le gocce di pioggia (“semina delle nubi”). Mezz’ora dopo pioveva. Bernard Vonnegut migliorò in seguito la tecnica, scoprendo che funzionava ancora meglio lo ioduro di argento in polvere, lanciato dal suolo verso l’alto; oggi, grazie a nuove tecniche, si ricorre alla pioggia artificiale per por fine – o tentare di farlo – alla siccità. Occorre comunque sempre che vi siano delle nuvole, per poter applicare queste tecniche. Sempre con questi metodi, nel 1961 gli astronomi sovietici riuscirono a provocare in una zona del cielo una parziale schiarita per poter osservare un’eclissi.

Fra gli altri interventi di “modificazione del tempo atmosferico” vanno ricordati i tentativi di impedire lo sviluppo degli uragani o almeno di moderarne la violenza, la semina delle nuvole per scongiurare le grandinate che mettono in pericolo i raccolti, i tentativi di dissipare la nebbia, e così via. In tutti questi casi si sono avuti risultati promettenti ma non veri e propri successi.

Inoltre, qualsiasi tentativo di modificare deliberatamente il tempo è destinato ad arrecare vantaggi a un settore a spese di un altro (un contadino potrà desiderare che piova, mentre il gestore di un parco di divertimenti sarà di avviso contrario), così che le cause legali sono un ovvio effetto collaterale dei programmi di modificazione del clima.

Non è dunque facile dire cosa ci riserva il futuro in questo campo. I razzi non hanno come unico scopo l’esplorazione (anche se questo è stato il solo uso che abbiamo citato nel capitolo terzo). Essi possono essere utilizzati al servizio quotidiano dell’umanità, come già è avvenuto. Anzi, anche alcune forme di esplorazione possono dare dei risultati pratici immediati. Se si mette in orbita, mediante un razzo, un satellite, esso può puntare i suoi strumenti, invece che verso lo spazio esterno, anche in direzione della terra. In tal modo i satelliti hanno consentito di avere per la prima volta una visione globale del nostro pianeta (o almeno di buona parte di esso in ogni momento), e di studiare la circolazione dell’aria nel suo complesso.

Il primo aprile del 1960 gli Stati Uniti lanciarono il primo satellite meteorologico, il “Tiros Primo” (“Tiros” sta per “Television Infrared Observation Satellite”, cioè satellite per l’osservazione televisiva all’infrarosso). Poi, nel novembre, venne lanciato “Tiros Secondo”, che in dieci settimane inviò a terra più di 20 mila immagini di vasti tratti della superficie terrestre e della sua coltre di nubi; notevoli fra queste le immagini di un ciclone nella Nuova Zelanda e di un ammasso di nubi nell’Oklahoma da cui, presumibilmente, stavano nascendo dei tornado. “Tiros Terzo”, lanciato nel luglio del 1961, fotografò diciotto tempeste tropicali, e, nel settembre, mostrò l’uragano Ester in formazione nei Caraibi due giorni prima che esso venisse individuato con i metodi tradizionali. Il più sensibile satellite, “Nimbus Primo”, lanciato il 28 agosto 1964, riuscì addirittura a inviare a terra fotografie delle nubi prese di notte. In seguito centinaia di stazioni automatiche per la trasmissione di immagini entrarono in funzione in molte nazioni, tanto che oggi è divenuto inconcepibile fare una previsione del tempo senza i dati forniti dai satelliti. Qualsiasi giornale, oggi, può pubblicare quotidianamente una fotografia della distribuzione dei banchi di nubi sugli Stati Uniti o altrove, e le previsioni meteorologiche, anche se, di sicuro, non hanno ancora raggiunto la certezza matematica, non sono più un semplice tirare a indovinare, come avveniva solo un quarto di secolo fa.

Veramente affascinante e utile è il modo con cui oggi i meteorologi sono in grado di individuare e seguire gli uragani. Queste violente tempeste sono diventate molto più dannose che in passato, perché i litorali, dopo la seconda guerra mondiale, sono più densi di fabbricati e più popolati, e se non disponessimo di una conoscenza certa della posizione e degli spostamenti di questi uragani, vi sarebbero indubbiamente perdite di vite umane e di beni molto superiori a quelle che si verificano oggi. (A proposito della questione dell’utilità e del valore dei programmi spaziali, già la sola segnalazione degli uragani da parte dei satelliti basta a ripagare abbondantemente i costi di tali programmi.)

Sono state sviluppate altre utilizzazioni «terrestri» dei satelliti. Già nel 1945 lo scrittore inglese di fantascienza Arthur C. Clarke aveva fatto notare che i satelliti avrebbero potuto essere usati come ripetitori per consentire ai messaggi radio di attraversare continenti e oceani, e che sarebbero stati sufficienti tre satelliti situati in posizioni strategiche per costituire una rete mondiale. Allora questo sembrava un sogno pazzesco, ma quindici anni dopo cominciò a diventare realtà. Il 12 agosto 1960 gli Stati Uniti lanciarono “Echo Prima”, un sottile pallone di poliestere rivestito di alluminio, che venne gonfiato nello spazio fino a raggiungere un diametro di 30 metri, in modo che potesse fungere da riflettore passivo delle onde radio. Uno dei responsabili del fortunato progetto era quel John Robinson Pierce dei Bell Telephone Laboratories, che aveva, a sua volta, pubblicato racconti di fantascienza sotto uno pseudonimo.

Il 10 luglio 1962, “Telstar Primo” venne lanciato dagli Stati Uniti; esso faceva qualcosa di più che riflettere semplicemente: riceveva le onde, le amplificava e le ritrasmetteva. Come risultato i programmi televisivi riuscirono per la prima volta ad attraversare gli oceani (anche se, naturalmente, ciò non ne migliorava la qualità). Il 26 luglio 1963 “Syncom Secondo” fu posto in un’orbita a 36 mila chilometri dalla superficie della terra. Il suo periodo orbitale era esattamente di 24 ore; pertanto esso restava indefinitamente librato al di sopra dell’Oceano Atlantico, compiendo la sua rotazione in sincronia con la terra. “Syncom Terzo”, collocato al di sopra dell’Oceano Indiano, anch’esso in sincronia con il moto della terra, ritrasmise i giochi olimpici dal Giappone agli Stati Uniti nell’ottobre del 1964.

Un satellite per le comunicazioni ancora più sofisticato, “Early Bird”, venne lanciato il 6 aprile 1965; esso rendeva disponibili 240 linee telefoniche e un canale televisivo. (In quell’anno anche l’Unione Sovietica cominciò a inviare nello spazio satelliti per le comunicazioni.) Durante gli anni settanta, grazie alla trasmissione via satellite, la televisione, la radio e la radiotelefonia hanno acquistato una dimensione planetaria. Dal punto di vista tecnologico, la terra è diventata un «mondo unico», e le forze politiche che lavorano in direzione opposta a questa realtà inevitabile diventano ogni giorno più arcaiche, anacronistiche e mortalmente pericolose. Il fatto che i satelliti possano essere usati per realizzare mappe della superficie terrestre e per studiare le nubi è ovvio. Non altrettanto ovvio, ma assolutamente vero, è il fatto che i satelliti possono studiare i mantelli nevosi, gli spostamenti dei ghiacciai, le caratteristiche geologiche su grande scala. In base a tali caratteristiche geologiche è possibile individuare le regioni in cui è probabile l’esistenza del petrolio; è possibile studiare le colture su larga scala, come pure le foreste, individuando con precisione regioni in cui si notano anomalie o malattie; si possono localizzare gli incendi nei boschi, e individuare le zone bisognose d’irrigazione; si può studiare l’oceano, con le sue correnti e gli spostamenti dei pesci. Questi satelliti che studiano le risorse terrestri sono la migliore risposta a quei critici che deplorano l’alto costo delle imprese spaziali, citando tutti i problemi irrisolti «di casa nostra».

Spesso è proprio dallo spazio che si possono studiare meglio tali problemi, trovando la via per risolverli. Infine, vi sono in orbita numerosi “satelliti spia”, destinati a scoprire gli spostamenti militari, le concentrazioni di truppe, gli arsenali e così via. Non manca certo chi progetta di fare dello spazio un’ennesima arena di guerra, o di costruire “satelliti killer” aventi lo scopo di abbattere i satelliti nemici, o di portare nello spazio armi ad alta tecnologia, assai più fulminee di quelle terrestri. Questo è il lato demoniaco dell’esplorazione spaziale, che tuttavia non può che accelerare in misura marginale i tempi con cui una guerra termonucleare globale potrebbe distruggere la civiltà.

Le due superpotenze, Stati Uniti e Unione Sovietica, dichiarano entrambe che loro scopo è «preservare la pace», scoraggiando l’altra parte dal fare la guerra. Questa teoria, secondo cui la pace verrebbe mantenuta in virtù della minaccia di una «reciproca distruzione assicurata», in quanto ciascuna delle due parti sa perfettamente che lo scoppio di una guerra porterebbe alla propria distruzione oltre che a quella dell’avversario, è pura pazzia, perché fino a oggi aumentare la quantità e la pericolosità degli armamenti non ha mai impedito le guerre.

I GAS PRESENTI NELL’ARIA

Gli strati inferiori dell’atmosfera

Prima dell’epoca moderna l’aria era considerata una sostanza semplice e omogenea; all’inizio del diciassettesimo secolo, il chimico fiammingo Jan Baptista van Helmont cominciò a sospettare che nell’aria vi fossero vari gas, chimicamente diversi; egli studiò il vapore emesso dalla fermentazione del succo di frutta (“anidride carbonica”), riconoscendovi una nuova sostanza. Van Helmont fu, in effetti, il primo a usare il termine “gas”: si suppone che egli abbia coniato questa parola, nel 1620 circa, rifacendosi al termine greco “chaos”, che indicava la sostanza originaria con cui è stato fatto l’universo.

Nel 1756 il chimico scozzese Joseph Black studiò a fondo l’anidride carbonica, stabilendo in modo preciso che si trattava di un gas diverso dall’aria, e dimostrando inoltre che ne esisteva nell’aria una modesta quantità. Dieci anni dopo Henry Cavendish studiò un gas infiammabile che non si trovava nell’atmosfera, a cui poi venne dato il nome di “idrogeno”; in tal modo era chiaramente dimostrata l’esistenza di più gas distinti tra loro. Il primo a comprendere che l’aria era una miscela di vari gas fu il chimico francese Antoine-Laurent Lavoisier, negli anni successivi al 1770. In uno dei suoi esperimenti egli scoprì che, riscaldando in un recipiente chiuso una certa quantità di mercurio, essa si combinava con parte dell’aria, formando una polvere rossa (“ossido mercurico”), mentre i quattro quinti dell’aria rimanevano sotto forma gassosa. Per quanto si seguitasse a riscaldare, il volume di questo gas residuo non diminuiva; inoltre, una candela introdotta in tale gas non bruciava e un topo non riusciva a sopravvivervi.

Lavoisier ne concluse che l’aria era costituita da due gas. La quinta parte che, nel suo esperimento, si combinava con il mercurio era la componente dell’aria che sosteneva la vita e consentiva la combustione, ed egli la denominò “ossigeno”, mentre chiamò la parte residua “azoto”, termine che in greco significa «senza vita».

Quest’ultimo fu chiamato, in diverse lingue, anche “nitrogeno”, perché era presente nel nitrato di sodio, detto comunemente “nitro”. Entrambi i gas erano stati scoperti nel decennio precedente, l’azoto nel 1772 dal medico scozzese Daniel Rutherford e l’ossigeno nel 1774 dal ministro della Chiesa unitaria inglese Joseph Priestley.

Già questo basta a dimostrare che l’atmosfera terrestre è unica nel sistema solare; oltre alla terra, sette mondi del sistema solare hanno un’atmosfera significativa, per quanto se ne sa. Giove, Saturno, Urano e Nettuno (i primi due certamente, gli ultimi due probabilmente) hanno

un’atmosfera di idrogeno, con la presenza di piccole quantità di elio; Marte e Venere hanno atmosfere di anidride carbonica, con azoto come costituente secondario; Titano ha un’atmosfera di azoto con una scarsa presenza di metano; è solo la terra ad avere un’atmosfera costituita da due gas in parti quasi uguali, e solo sulla terra l’ossigeno è un componente importante: l’ossigeno è un gas attivo, così che, in base a semplici considerazioni di carattere chimico, ci si aspetterebbe che

si combini con altri elementi, scomparendo dall’atmosfera in quanto gas libero; torneremo su questo punto più avanti, in questo stesso capitolo, seguitando per il momento a occuparci della composizione chimica dell’aria. Verso la metà del diciannovesimo secolo il chimico francese Henri Victor Regnault aveva analizzato campioni di aria provenienti dalle più svariate parti del mondo e aveva scoperto che la composizione dell’aria era uguale ovunque: il contenuto di ossigeno era del 20,9per cento, e si supponeva che tutto il resto fosse azoto, salvo una piccola traccia di anidride carbonica.

L’azoto è un gas relativamente inerte, non si combina cioè facilmente con altre sostanze; tale combinazione può però venir provocata: per esempio, riscaldandolo con magnesio metallico, si ottiene “nitruro di magnesio” solido. Alcuni anni dopo la scoperta di Lavoisier, Henry Cavendish cercò di eliminare tutto l’azoto, combinandolo con l’ossigeno sotto l’azione di una scarica elettrica, ma senza successo.

Pur provando in tutti i modi, non riusciva a liberarsi di una bollicina di gas residuo, meno dell’uno per cento della quantità originaria. Cavendish pensò che potesse trattarsi di un gas

sconosciuto, ancora più inerte dell’azoto. Ma non tutti i chimici sono dei Cavendish, così che nessuno si occupò più dell’enigma e la natura di questo residuo non fu chiarita per un altro secolo.

Nel 1882 il fisico inglese Robert John Strutt, Lord Rayleigh, confrontò la densità dell’azoto ottenuto dall’aria con la densitàdell’azoto ottenuto da determinate altre sostanze chimiche, e scoprì, con grande sorpresa, che quello proveniente dall’aria era decisamente più denso. Poteva forse darsi che l’azoto ottenuto dall’aria non fosse puro, ma contenesse piccole quantità di un altro gas più pesante? Un chimico scozzese, Sir William Ramsay, aiutò Lord Rayleigh a andare più a fondo nella faccenda, cosa che i due fecero ricorrendo all’aiuto della spettroscopia. Quando riscaldarono il piccolo residuo di gas rimasto dopo l’eliminazione dell’azoto dall’aria e ne esaminarono lo spettro, trovarono una nuova serie di righe luminose, che non appartenevano ad alcun elemento noto. Essi diedero il nome di “argo” (in greco «inerte») all’elemento appena scoperto, che era appunto altamente inerte.

L’argo rendeva ragione di quasi tutto quell’uno per cento di gas ignoto presente nell’aria; nell’atmosfera c’erano però anche tracce di diversi altri costituenti, ciascuno nella proporzione di qualche parte per milione. Durante gli anni successivi al 1890 Ramsay proseguì nelle sue ricerche e scoprì altri quattro gas inerti: il “neon” («nuovo»), il “cripto” («nascosto»), lo “xeno” («straniero») e l'”elio”, che era stato identificato più di trent’anni prima nel sole. In epoca più recente lo spettroscopio per infrarosso ha rivelato la presenza di altri tre gas: il “protossido di azoto” (detto «gas esilarante»), di provenienza sconosciuta, il “metano”, un prodotto della decomposizione delle sostanze organiche e il “monossido di carbonio”. Il metano proviene dalle esalazioni delle paludi; si è inoltre calcolato che ogni anno vengono immessi nell’atmosfera circa 40 milioni di tonnellate di questa sostanza, derivanti dalla emissione di gas intestinali da parte di bovini e altri animali di grosse dimensioni; il monossido di carbonio, probabilmente, è dovuto alle attività umane, provenendo dalla combustione incompleta di legno, carbone, benzina e

altre sostanze simili.

LA STRATOSFERA

Fin qui ci siamo occupati della composizione degli strati inferiori dell’atmosfera. Cosa si sa della stratosfera? Teisserenc de Bort pensava che potessero esservi presenti in quantità significative elio e idrogeno, che galleggiano sui gas più pesanti. Ma si sbagliava. Verso la metà degli anni trenta i russi, avendo raggiunto in pallone l’alta stratosfera, ne riportarono dei campioni di aria, che risultarono composti di ossigeno e azoto nella stessa proporzione di 1 a 4 caratteristica dell’aria della troposfera.

Vi erano però ragioni per credere che nell’atmosfera superiore esistessero, ancora più in alto, degli strani gas; una di tali ragioni era il fenomeno della debole luminescenza diffusa (“airglow”) che si osserva in tutto il cielo notturno, anche in assenza della luna; luminescenza che globalmente supera di molto quella delle stelle, ma è così diffusa che non la si nota a occhio nudo, mentre i sensibili strumenti fotometrici degli astronomi sono in grado di rivelarla. Per molti anni l’origine di tale luminescenza rimase un mistero. Nel 1928 l’astronomo V. M. Slipher riuscì a individuare nella luce diffusa certe misteriose righe spettrali già trovate nel 1864 da William Huggins nelle nebulose; allora si era pensato che provenissero da un elemento sconosciuto, a cui era stato dato il nome di “nebulio”. Ma nel 1927 l’astronomo americano Ira Sprague Bowen dimostrò sperimentalmente che le righe provenivano da “ossigeno atomico”, cioè ossigeno sotto forma di singoli atomi anziché combinato nella normale molecola biatomica. Analogamente, si trovò che altre strane righe spettrali rilevate nelle aurore polari erano dovute ad azoto atomico. L’ossigeno e l’azoto atomici sono prodotti nell’atmosfera superiore dalle radiazioni ad alta energia provenienti dal sole, le quali spezzano le molecole in atomi singoli – una spiegazione questa suggerita per la prima volta nel 1931 da Sydney Chapman.

Fortunatamente ciò fa sì che la radiazione ad alta energia venga assorbita, o almeno indebolita, prima di raggiungere l’atmosfera inferiore.

La luminescenza diffusa del cielo notturno proviene, secondo Chapman, dalla ricombinazione che avviene durante la notte degli atomi che vengono separati dall’energia solare durante il giorno.

Ricombinandosi, gli atomi cedono parte dell’energia che avevano assorbito nel separarsi, così che la luminescenza diffusa costituisce una sorta di restituzione differita e molto debole della luce solare in una forma nuova e particolare. Esperimenti effettuati nel 1956 – in laboratorio e, per mezzo di razzi, nell’atmosfera superiore – sotto la direzione di Murray Zelikoff hanno fornito conferma diretta di questa teoria. Spettroscopi trasportati nello spazio dai razzi registrarono le righe verdi dell’ossigeno atomico con la massima intensità all’altezza di 96 chilometri. La percentuale di azoto sotto forma di atomi liberi era più modesta, perché le molecole di azoto hanno un legame più stretto di quello delle molecole di ossigeno; purtuttavia la luce rossa dell’azoto atomico era intensa a un’altezza di 150 chilometri.

Slipher aveva anche trovato, nella luminescenza diffusa dell’atmosfera, alcune righe che lo avevano insospettito, perché erano molto simili alle ben note righe emesse dal sodio. La presenza del sodio sembrava così poco probabile che tutta la questione fu abbandonata fra molte perplessità. Cosa avrebbe mai dovuto farci proprio il sodio negli strati superiori dell’atmosfera? Dopo tutto non è un gas, ma un metallo molto reattivo che non si trova mai da solo sulla terra, ma sempre in combinazione con altri elementi, soprattutto sotto forma di “cloruro di sodio”, il comune sale da tavola.

Nel 1938, però, gli scienziati francesi stabilirono che le righe erano davvero identiche a quelle del sodio. Per improbabile che fosse la cosa, doveva esserci del sodio nell’atmosfera superiore. Ancora una volta furono gli esperimenti consentiti dai razzi a risolvere la questione: gli spettroscopi di bordo registrarono inequivocabilmente la riga gialla del sodio con un massimo di intensità all’altezza di 88 chilometri. Resta tuttora un mistero da dove provenga questo sodio – forse da spruzzi di sale dell’oceano o dalla vaporizzazione delle meteore. E’ ancora più strano, poi, che anche il “litio” – un raro elemento affine al sodio – contribuisca all’effetto della luminescenza notturna diffusa, come fu scoperto nel 1958.

Nel corso dei loro esperimenti, Zelikoff e i suoi collaboratori produssero una luminescenza diffusa artificiale, lanciando un razzo che rilasciò ad alta quota una nube gassosa di ossido di azoto, capace di accelerare la ricombinazione degli atomi di ossigeno nell’atmosfera superiore. Gli osservatori a terra poterono facilmente scorgere il bagliore luminoso in tal modo prodotto. Analogo successo ebbe un esperimento simile condotto con il vapore di sodio, che diede origine a una luminescenza gialla, chiaramente visibile. Quando, nell’ottobre del 1959, gli scienziati sovietici inviarono nello spazio il “Lunik terzo” in direzione della luna, fecero in modo che esso espellesse una nube di vapori di sodio per segnalare visibilmente la propria entrata in orbita.

A livelli più bassi dell’atmosfera l’ossigeno atomico scompare, ma la radiazione solare ha ancora un’energia sufficiente a provocare la formazione dell'”ozono”, la varietà triatomica dell’ossigeno. La concentrazione dell’ozono è massima all’altezza di 24 chilometri.

Anche lì, in quella che viene chiamata “ozonosfera” (scoperta nel 1913 dal fisico francese Charles Fabry), esso rappresenta una frazione dell’aria pari soltanto a una parte su 4 milioni, il che tuttavia è sufficiente ad assorbire la luce ultravioletta in misura bastante per proteggere la vita sulla terra.

L’ozono è formato dalla combinazione dell’ossigeno atomico (un atomo singolo) con le normali molecole di ossigeno (formate da due atomi). Esso non si accumula in grandi quantità, perché è instabile: la molecola triatomica si spezza facilmente, dando origine alla molto più stabile forma biatomica, per azione della luce solare, del protossido d’azoto presente naturalmente in quantità minime nell’atmosfera e di altre sostanze chimiche. L’equilibrio tra la formazione e la scissione delle molecole di ozono determina la presenza costante nell’ozonosfera della piccola concentrazione sopra riferita, che costituisce uno scudo contro le radiazioni solari ultraviolette (le quali altrimenti spezzerebbero gran parte delle delicate molecole indispensabili alla vita) e che ha protetto la vita fin dall’epoca remota in cui l’ossigeno è entrato a far parte in quantità notevole dell’atmosfera terrestre.

L’ozonosfera non è molto al di sopra della tropopausa e varia di altezza allo stesso modo: è cioè più bassa ai poli e più elevata all’equatore. L’ozonosfera è più ricca di ozono ai poli e più povera all’equatore, dove l’effetto distruttivo della radiazione solare è maggiore.

Sarebbe molto pericoloso se la tecnologia umana dovesse produrre un’accelerazione del fenomeno di scissione dell’ozono nelle parti superiori dell’atmosfera, indebolendo così lo scudo costituito dall’ozonosfera. L’indebolimento di tale scudo farebbe aumentare la quantità di radiazione ultravioletta che raggiunge la superficie della terra, il che a sua volta causerebbe un aumento di incidenza del cancro della pelle – soprattutto tra le popolazioni di pelle chiara.

Si è stimato che una riduzione del 5 per cento della protezione assicurata dallo scudo di ozono potrebbe provocare, a livello mondiale, un aumento di 500 mila casi all’anno di cancro della pelle.

Se aumentasse la concentrazione della radiazione ultravioletta, ne potrebbe risentire anche la vita microscopica alla superficie del mare (“plancton”), con probabili conseguenze catastrofiche, dato che il plancton costituisce la base della catena alimentare marina e, in una certa misura, anche terrestre.

Esiste in effetti un pericolo reale che la tecnologia umana possa compromettere l’ozonosfera: gli aerei a reazione volano sempre più numerosi nella stratosfera, mentre i razzi attraversano tutta l’atmosfera per raggiungere lo spazio esterno. Col tempo, le sostanze chimiche riversate nell’atmosfera superiore dagli scarichi di questi veicoli potrebbero accelerare la scissione dell’ozono. Questa eventualità è stata usata come argomento contro lo sviluppo degli aerei supersonici, all’inizio degli anni settanta.

Nel 1974 si è scoperto, inaspettatamente, che le bombole spray potevano costituire un pericolo, in quanto vengono riempite di freon per ottenere la pressione necessaria a provocare la fuoriuscita, sotto forma di aerosol, del contenuto delle bombolette (per esempio deodoranti, prodotti per i capelli, profumi eccetera). Il freon di per sé, dal punto di vista chimico, è il più innocuo dei gas immaginabili – incolore, inodore, inerte, non reattivo, senza alcun effetto sugli esseri umani. Allorché si cominciò a parlare di una sua possibile pericolosità, ne venivano immesse nell’atmosfera

ogni anno, con l’uso di bombole o di congegni vari, qualcosa come 770 mila tonnellate.

Il gas, che non reagisce con nessuna sostanza, si diffonde lentamente nell’atmosfera, raggiungendo infine l’ozonosfera, dove potrebbe accelerare il processo di rottura dell’ozono. Questa eventualità fu prospettata in base a prove di laboratorio. Resta incerto se nelle condizioni esistenti nell’atmosfera superiore ciò possa avvenire realmente, ma anche la sola eventualità costituisce un rischio troppo grande per liquidare il problema superficialmente. L’uso di bombole spray che utilizzano il freon come propellente è diminuito decisamente da quando è sorta questa controversia.

Tuttavia, il freon viene usato in misura molto maggiore per il condizionamento dell’aria e la refrigerazione, dove non lo si è potuto abbandonare con altrettanta facilità e neppure lo si è potuto sostituire; pertanto l’ozonosfera seguita a essere in pericolo, perché il freon, una volta prodotto, è destinato a essere scaricato presto o tardi nell’atmosfera.

LA IONOSFERA

L’ozono non è il solo costituente dell’atmosfera che a grande altezza si trovi in proporzioni molto maggiori che in prossimità della superficie terrestre. Ulteriori esperimenti effettuati mediante i razzi hanno mostrato che le ipotesi avanzate da Teisserenc de Bort sugli strati di elio e idrogeno non erano sbagliate, ma semplicemente collocavano tali strati fuori di posto. Dai 320 ai 1000 chilometri di altezza, dove l’atmosfera diventa talmente rarefatta da approssimarsi al vuoto, esiste uno strato di elio, oggi chiamato “eliosfera”. L’esistenza di tale strato venne dedotta per la prima volta nel 1961 dal fisico belga Marcel Nicolet in base all’effetto dell’attrito sul satellite “Echo Prima”. Questa deduzione venne confermata quando si poté effettuare l’analisi del gas rarefatto tramite “Explorer Diciassettesimo”, lanciato il 2 aprile 1963.

Al di sopra dell’eliosfera vi è uno strato ancora più tenue di idrogeno, la “protonosfera”, che si estende verso l’alto forse per circa 65 mila chilometri, prima di svanire raggiungendo gradualmente la densità dello spazio interplanetario.

Le alte temperature e la radiazione ad alta energia possono fare molto di più che dissociare gli atomi di una molecola o provocarne nuove combinazioni. Possono strappare gli elettroni dagli atomi, “ionizzando” questi ultimi. Ciò che resta dell’atomo viene chiamato “ione”, e differisce da un atomo normale per il fatto che è dotato di carica elettrica. Il termine ione fu introdotto negli anni trenta del diciannovesimo secolo dallo studioso inglese William Whewell e deriva da una parola greca che significa «viaggiante»; la ragione di tale nome sta nel fatto che quando una corrente elettrica attraversa una soluzione contenente degli ioni, gli ioni di carica positiva viaggiano in una direzione, mentre quelli di carica negativa migrano nella direzione opposta. Un giovane chimico svedese, Svante August Arrhenius, (ndr zio di Greta ) fu il primo a suggerire, nel 1884, che gli ioni fossero atomi dotati di carica, per spiegare il comportamento, altrimenti incomprensibile, di certe soluzioni che conducevano la corrente elettrica. Le idee di Arrhenius, esposte nella sua tesi di dottorato presentata in quell’anno, erano talmente rivoluzionarie che gli esaminatori a fatica si risolsero a promuoverlo. Le particelle cariche all’interno dell’atomo non erano ancora state scoperte, e l’idea di un atomo elettricamente carico appariva ridicola. Arrhenius conseguì il dottorato ma con il voto minimo.

Quando, sul finire del secolo scorso, venne scoperto l’elettrone (vedi capitolo sesto), improvvisamente la teoria di Arrhenius assunse un significato sorprendente. Nel 1903 gli fu assegnato il premio Nobel per la chimica per quella stessa tesi che diciannove anni prima aveva

messo in pericolo il suo dottorato. (Tutto ciò, lo ammetto, potrebbe sembrare un’improbabile trama di film, ma la storia della scienza contiene molti episodi che fanno impallidire la fantasia

hollywoodiana.)

La scoperta degli ioni nell’atmosfera avvenne solo dopo gli esperimenti di Guglielmo Marconi con il telegrafo senza fili. Quando, il 12 dicembre 1901, egli inviò dei segnali dalla Cornovaglia a Terranova attraverso 3400 chilometri di Oceano Atlantico, gli scienziati rimasero stupefatti: le onde radio viaggiano solo in linea retta; come avevano dunque potuto seguire la curvatura della terra, raggiungendo l’isola di Terranova?

Un fisico britannico, Oliver Heaviside, e un ingegnere elettrotecnico americano, Arthur Edwin Kennelly, suggerirono ben presto che i segnali radio potevano esser stati riflessi verso terra da uno strato di particelle cariche nella parte alta dell’atmosfera. Lo “strato di Kennelly-Heaviside”, come venne chiamato in seguito, fu infine localizzato nel 1922. Il fisico inglese Edward Victor Appleton lo individuò mentre studiava uno strano fenomeno di affievolimento (“fading”) nelle trasmissioni radiofoniche. Egli giunse alla conclusione che tale fenomeno era prodotto da un’interferenza tra due segnali aventi origine comune: uno che dal trasmettitore raggiungeva direttamente il ricevitore, l’altro che percorreva un cammino più lungo venendo riflesso dalla parte superiore dell’atmosfera. L’onda ritardata era sfasata rispetto alla prima, così che le due onde si cancellavano parzialmente, provocando il “fading”.

A questo punto era facile trovare l’altezza dello strato riflettente; tutto ciò che Appleton doveva fare era inviare dei segnali di lunghezza d’onda tale che il segnale diretto cancellasse completamente quello riflesso, cioè tale che i due segnali arrivassero con fasi esattamente opposte. In base alla lunghezza d’onda del segnale usato e alla velocità nota delle radioonde, Appleton poté calcolare la differenza dei cammini percorsi dai due treni d’onda; in tal modo egli poté stabilire, nel 1924, che lo strato di Kennelly-Heaviside si trovava a un’altezza di circa 105 chilometri.

Il fading dei radiosegnali avveniva solitamente di notte. Nel 1926 Appleton scoprì che poco prima dell’alba le onde radio non venivano riflesse dallo strato di Kennelly-Heaviside, ma da strati ancora più alti (che oggi vengono talora chiamati “strati di Appleton”), che cominciano all’altezza di 225 chilometri.

Per tutte queste scoperte Appleton ricevette il premio Nobel per la fisica nel 1947; era stato lui a localizzare l’importante regione dell’atmosfera chiamata “ionosfera” (termine introdotto nel 1930 dal fisico scozzese Robert Alexander Watson-Watt). La ionosfera include quelle che in seguito furono chiamate mesosfera e termosfera, e oggi viene suddivisa in strati. Dalla stratopausa fino a un’altezza di circa 105 chilometri, si estende la “regione D”; al di sopra di questa vi è lo strato di Kennelly-Heaviside, chiamato “strato D”; sopra questo strato, e fino a un’altezza di 225 chilometri, vi è la “regione E” – una zona intermedia relativamente povera di ioni. Seguono gli strati di Appleton: lo “strato F1”, a 225 chilometri, e lo “strato F2” a 320; il primo è più ricco di ioni, mentre il secondo è significativamente ionizzato solo durante il giorno. Al di sopra di questi strati vi è la “regione F”. Questi strati riflettono e assorbono solo le onde radio lunghe, usate normalmente per le trasmissioni radiofoniche, mentre le onde più corte, per esempio quelle usate nelle trasmissioni televisive, per la maggior parte li attraversano. E’ questa la ragione che limita la portata delle trasmissioni televisive – limite a cui si è posto rimedio collocando in orbita alcuni satelliti che fungono da ripetitori, permettendo le trasmissioni televisive in diretta attraverso oceani e continenti. Anche le radioonde provenienti dallo spazio (per esempio dalle radio-stelle) possono attraversare la ionosfera: è una fortuna, perché altrimenti non sarebbe possibile la radioastronomia dalla superficie terrestre.

La ionosfera è più efficace verso sera, dopo che ha subìto l’effetto della radiazione solare per tutto l’arco della giornata, mentre si affievolisce verso l’alba, quando molti ioni ed elettroni si sono ricombinati. Le tempeste solari, intensificando il flusso di particelle e di radiazione ad alta energia inviato verso la terra, aumentano il grado di ionizzazione e lo spessore degli strati ionizzati. Anche le zone al di sopra della ionosfera si accendono di bagliori dando origine a manifestazioni aurorali. Durante queste tempeste elettriche la trasmissione a grande distanza delle onde radio sulla terra è estremamente disturbata, e talvolta anche del tutto impedita.

Si è poi scoperto che la ionosfera non è che una delle fasce di radiazione che circondano la terra. Al di fuori dell’atmosfera, in quello che veniva considerato «spazio vuoto», nel 1958 i satelliti scoprirono qualcosa di veramente sorprendente: ma per comprendere di che cosa si trattasse, occorre prima fare una breve digressione sul magnetismo.

I MAGNETI

I magneti hanno preso nome dall’antica città greca di Magnesia, presso la quale furono scoperte le prime “magnetiti”. La magnetite (o calamita naturale) è un ossido di ferro che ha proprietà magnetiche naturali. La tradizione vuole che Talete di Mileto sia stato il primo filosofo a descriverla, attorno al 550 avanti Cristo.

Magnetismo ed elettricità

I magneti diventarono qualcosa di più di una semplice curiosità quando si scoprì che un ago di acciaio messo a contatto con una calamita restava magnetizzato e che, lasciato libero di ruotare in un piano orizzontale, esso finiva col disporsi approssimativamente lungo la direzione nord-sud. Naturalmente tale ago risultò di enorme utilità per i naviganti; esso divenne praticamente indispensabile per la navigazione oceanica, anche se i polinesiani riuscirono ad attraversare il Pacifico da isola a isola senza bussola. Non sappiamo chi fu il primo a collocare un ago magnetizzato su un perno e a chiuderlo in un contenitore, realizzando una bussola. Si dice che i primi a farlo furono i cinesi, che avrebbero trasmesso la loro invenzione agli arabi, i quali, a loro volta, l’avrebbero comunicata agli europei. Ma si tratta di notizie dubbie, forse solo di una leggenda. Ad ogni modo, nel dodicesimo secolo la bussola entrò nell’uso comune in Europa, e nel 1269 uno studioso francese, più noto con il nome latinizzato di Petrus Peregrinus, la descrisse dettagliatamente. Peregrinus chiamò “polo nord” e “polo sud” i due estremi del magnete che puntano rispettivamente verso i punti cardinali nord e sud. Naturalmente ci si chiese la ragione per cui un ago magnetizzato punta verso il nord. Poiché si sapeva che i magneti si attraggono tra loro, qualcuno pensò che esistesse, all’estremo nord, una gigantesca montagna di magnetite verso cui tendeva l’ago. (Nelle “Mille e una notte”, il racconto di Sindbad il Marinaio ricorre all’immagine di questa montagna, sortendo un grande effetto letterario.) Altri si dimostrarono ancora più fantasiosi, attribuendo ai magneti un’«anima» e una sorta di vita.

Lo studio scientifico dei magneti iniziò con William Gilbert, il medico di corte della regina Elisabetta Prima; fu Gilbert a scoprire che la terra stessa è un gigantesco magnete. Egli montò un ago magnetizzato in modo che potesse ruotare in un piano verticale (“bussola di inclinazione”): il polo nord dell’ago si orientò verso il suolo (“inclinazione magnetica”). Usando una calamita sferica come modello della terra, Gilbert trovò che l’ago si comportava allo stesso modo quando era situato sull’emisfero settentrionale della sua sfera. Gilbert pubblicò i risultati dei suoi esperimenti nel 1600 in un’operaclassica, intitolata “De Magnete”.

Gli scienziati discussero a lungo la possibilità che la terra avesse come nucleo un gigantesco magnete naturale. Pur essendo risultato vero che la terra ha un nucleo di ferro, oggi si sa che esso non può sicuramente essere un magnete, perché il ferro, riscaldato, perde le sue intense proprietà magnetiche (“ferromagnetismo”) a 760 gradi C, mentre la temperatura del nucleo terrestre deve essere di almeno 1000 gradi C.

La temperatura alla quale una sostanza perde le proprietà magnetiche viene chiamata “temperatura di Curie”, essendo stata scoperta da Pierre Curie nel 1895. Anche il cobalto e il nichel, che hanno una stretta somiglianza con il ferro sotto molti aspetti, sono ferromagnetici. Per il nichel la temperatura di Curie è di 356 gradi C, per il cobalto di 1075 gradi C. Alle basse temperature, anche alcuni altri metalli sono ferromagnetici; per esempio lo è il disprosio, sotto i meno 188 gradi C. In generale il magnetismo è una proprietà intrinseca dei singoli atomi; ma in quasi tutti i materiali i minuscoli magneti atomici sono orientati in modo casuale, il che causa l’eliminazione reciproca quasi completa dell’effetto; ciononostante, spesso si nota ancora la presenza di deboli proprietà magnetiche, che vanno sotto il nome di “paramagnetismo”. L’intensità del magnetismo viene espressa in termini di “permeabilità”: la permeabilità del vuoto è 1,00, mentre quella delle sostanze paramagnetiche è compresa tra 1,00 e 1,01. Le sostanze ferromagnetiche hanno permeabilità molto maggiori. Il nichel ha una permeabilità pari a 40, il cobalto a 55, il ferro dell’ordine delle migliaia. Nel 1907 il fisico francese Pierre Weiss postulò l’esistenza in tali sostanze di “domini”, cioè di piccolissime zone, con un diametro compreso fra 0,001 e 0,1 centimetri (che sono state effettivamente osservate), entro le quali i magneti atomici sono allineati in modo da rinforzarsi a vicenda, producendo dei campi totali intensi. Nel comune ferro non magnetizzato, questi domini sono orientati in modo casuale, e annullano l’uno gli effetti dell’altro. Quando invece i domini vengono orientati parallelamente dall’azione di un altro magnete, il ferro risulta magnetizzato. Il riorientamento dei domini durante la magnetizzazione produce effettivamente schiocchi e sfrigolii di assestamento che possono essere rilevati con un’opportuna amplificazione; essi costituiscono l'”effetto Barkhausen”, dal nome del loro scopritore, il fisico tedesco Heinrich Barkhausen. Anche nelle “sostanze antiferromagnetiche”, come il manganese, i domini si allineano, ma in direzioni alternate, il che elimina quasi del tutto il magnetismo; al di sopra di una data temperatura, le sostanze perdono l’antiferromagnetismo, diventando paramagnetiche.

Se il nucleo di ferro della terra non è esso stesso un magnete permanente, a causa della sua temperatura superiore a quella di Curie, si deve trovare un’altra spiegazione dell’azione della terra sull’ago della bussola. Tale spiegazione cominciò a emergere in conseguenza delle scoperte dello scienziato inglese Michael Faraday sulla relazione tra magnetismo ed elettricità.

Nel secondo decennio del secolo scorso, Faraday prese le mosse da un esperimento che era stato in precedenza descritto da Petrus Peregrinus, e che ancora oggi costituisce una fonte di divertimento per i giovani studenti di fisica. Esso consiste nel cospargere di una fine limatura di ferro un foglio di carta posto sopra a una calamita, dando poi dei leggeri colpetti al foglio stesso: la limatura così scossa tende ad allinearsi formando degli archi diretti dal polo nord al polo sud del magnete. Faraday affermò che questi archi indicavano delle vere e proprie “linee di forza magnetiche”, formanti un “campo magnetico”.

Faraday aveva iniziato a indagare sul fenomeno del magnetismo in seguito agli studi del fisico danese Hans Christiaan Oersted. Avendo quest’ultimo scoperto, in un suo esperimento del 1820, che una corrente elettrica che percorre un filo metallico posto nelle vicinanze di una bussola ne fa deviare l’ago, Faraday giunse alla conclusione che la corrente dovesse generare delle linee di forza magnetiche intorno al filo metallico stesso. La sua convinzione si era rafforzata anche per gli studi sui conduttori effettuati dal fisico francese André Marie Ampère subito dopo la scoperta di Oersted. Ampère aveva dimostrato che due conduttori paralleli in cui la corrente scorreva nella stessa direzione si attraevano tra loro, mentre si respingevano se la corrente scorreva in direzioni opposte. Ciò ricordava da vicino quanto avviene tra due poli magnetici, che si respingono se uguali (entrambi poli nord o entrambi poli sud), e si attirano se opposti. Ma Ampère andò oltre dimostrando che una bobina cilindrica di filo metallico (“solenoide”) in cui veniva fatta passare una corrente elettrica si è in ricordo di questo suo lavoro che, nel 1881, l’unità di misura dell’intensità di corrente elettrica è stata ufficialmente denominata “ampère”. Stando così le cose, rifletté Faraday (e la sua fu una delle più feconde intuizioni della storia della scienza), se l’elettricità può indurre un campo magnetico tanto simile a quello di un magnete reale che dei fili metallici percorsi dalla corrente si comportano come vere e proprie calamite, perché non dovrebbe valere anche l’inverso? Perché un magnete non dovrebbe indurre una corrente elettrica, del tutto simile alla corrente prodotta da una batteria chimica?

Nel 1831, Faraday eseguì un esperimento che doveva cambiare la storia dell’umanità. Avvolse a spirale un filo metallico intorno a un segmento di un anello di ferro, e un secondo filo intorno a un altro segmento dello stesso anello; poi collegò la prima spirale a una batteria. Il suo ragionamento era il seguente: quando una corrente avesse percorso la prima spirale, si sarebbero create delle linee di forza magnetica che si sarebbero concentrate nell’anello di ferro, e questo magnetismo indotto avrebbe dovuto, a sua volta, produrre una corrente nel secondo avvolgimento. Per rivelare la presenza di tale corrente, Faraday collegò la seconda spirale a un “galvanometro” – uno strumento per misurare le correnti elettriche, che era stato ideato dal fisico tedesco Johann Salomon Christoph Schweigger nel 1820.

L’esperimento non ebbe l’esito previsto da Faraday: il flusso di corrente nel primo avvolgimento non generò nulla nel secondo. Tuttavia, Faraday notò che l’ago del galvanometro, nel momento in cui egli aveva fatto passare la corrente, si era leggermente mosso, e che lo stesso era avvenuto, ma in direzione opposta, quando egli aveva tolto la corrente. Immediatamente formulò l’ipotesi che a provocare la corrente fosse il movimento delle linee di forza magnetiche concatenate al filo metallico, e non il magnetismo in se stesso. Quando una corrente cominciava a passare nel primo avvolgimento, essa originava un campo magnetico, che, propagandosi, tagliava la seconda spirale, inducendovi una corrente elettrica istantanea. Inversamente, quando si interrompeva la corrente della batteria, le linee di forza magnetiche venivano meno e di nuovo tagliavano il filo del secondo avvolgimento, provocando un breve impulso di corrente in direzione opposta a quella del flusso precedente.

Faraday aveva così scoperto il principio dell’induzione elettrica e creato il primo “trasformatore”. Egli proseguì i suoi esperimenti, dando una dimostrazione più evidente del fenomeno con il ricorso a un magnete permanente, che spostava dentro e fuori da un solenoide; benché non fosse presente alcuna fonte di elettricità, una corrente passava nel filo tutte le volte che esso intersecava le linee di forza del magnete. Le scoperte di Faraday non solo portarono direttamente alla creazione della dinamo per la produzione di elettricità, ma posero anche le basi su cui poi James Clerk Maxwell eresse la propria teoria “elettromagnetica”, che collegava la luce con altre forme di radiazione (come le onde radio) in un’unica famiglia, quella delle “radiazioni elettromagnetiche”.

Il campo magnetico terrestre

La stretta relazione tra magnetismo ed elettricità fornisce una possibilità di spiegare il magnetismo terrestre. L’ago della bussola ha messo in evidenza le linee di forza del campo magnetico terrestre,

che vanno dal “polo magnetico nord”, situato a nord del Canada, al “polo magnetico sud”, situato al limite dell’Antartide: i due poli si trovano entrambi a circa 15 gradi di latitudine dai poli geografici.

(Il rilevamento del campo magnetico terrestre è stato effettuato anche a grande altezza mediante razzi forniti di “magnetometri”.) L’idea nuova è che il magnetismo terrestre dipenda dalla presenza di correnti elettriche che scorrono in profondità all’interno della terra. Il fisico Walter Maurice Elsasser ha proposto che la rotazione della terra produca, nel nucleo di ferro fuso, dei lenti vortici in direzione ovest-est. Questi vortici avrebbero l’effetto di generare una corrente elettrica, anch’essa diretta da ovest verso est; la corrente elettrica circolante produrrebbe delle linee di forza magnetiche nel nucleo terrestre, esattamente come avveniva nell’esperimento di Faraday: si originerebbe così l’equivalente di un magnete interno orientato in direzione nord-sud. Questo magnete, a sua volta, spiegherebbe la presenza del campo magnetico generale della terra, orientato approssimativamente lungo l’asse di rotazione, in modo che i poli magnetici risultano vicini ai poli geografici. Anche il sole ha un campo magnetico globale, che ha un’intensità doppia o tripla di quella del campo magnetico terrestre; inoltre esso presenta campi magnetici locali, che sembrano essere associati alle macchie solari: questi ultimi sono migliaia di volte più intensi.

Studi effettuati su questi campi (resi possibili dal fatto che un intenso campo magnetico altera la lunghezza d’onda della luce emessa) fanno pensare che all’interno del sole possano esservi flussi circolari di cariche elettriche.

In effetti, molte caratteristiche enigmatiche delle macchie solari potrebbero essere chiarite una volta che si fossero decifrate le cause dei campi magnetici su scala astronomica. Le macchie solari appaiono solo a certe latitudini, ma, durante un ciclo, queste latitudini mutano. Le macchie presentano un dato orientamento magnetico, che si inverte a ogni nuovo ciclo, così che il ciclo completo da un massimo con un orientamento magnetico a un massimo successivo con lo stesso orientamento magnetico, dura in media circa 21 anni. Le ragioni di queste attività delle macchie solari non sono ancora note. Ma non occorre andare sul sole per trovare misteri relativi ai campi magnetici. I problemi abbondano anche qui, sulla terra. Per esempio, perché i poli magnetici non coincidono con quelli geografici? Il polo magnetico nord dista circa 1600 chilometri dal polo nord, e lo stesso accade per il polo sud. Inoltre i poli magnetici non sono diametralmente opposti: la linea che li congiunge (“asse magnetico”) non passa per il centro della terra. Per di più, la deviazione dell’ago della bussola rispetto al vero nord (cioè alla direzione del polo nord) varia in modo irregolare quando ci si sposta verso est o verso ovest. Durante il primo viaggio di Colombo l’ago della bussola presentò proprio tale fenomeno – circostanza che egli tenne nascosta per evitare che il suo equipaggio cadesse in preda al terrore e lo obbligasse a ritornare indietro.

Questa è una delle ragioni per cui l’uso della bussola magnetica per determinare la direzione è tutt’altro che soddisfacente. Nel 1911 l’inventore americano Elmer Ambrose Sperry introdusse un metodo per stabilire la direzione che, anziché basarsi sul magnetismo, si fondava sul fatto che una ruota con il bordo pesante in rapida rotazione (un “giroscopio”, studiato per la prima volta da quello stesso Foucault che aveva dimostrato che la terra gira) tende a opporre resistenza a qualsiasi mutamento del piano di rotazione; tale tendenza può essere sfruttata per ottenere una “bussola giroscopica”, che conserva l’orientamento verso una data direzione e può fungere da guida per navi e razzi.

Pur essendo lungi dalla perfezione, la bussola magnetica è stata utilizzata vantaggiosamente dagli esseri umani per secoli; della deviazione dell’ago magnetico dal vero nord si può tener conto. Un secolo dopo Colombo, nel 1581, l’inglese Robert Norman preparò la prima mappa che indicava la direzione reale assunta dall’ago della bussola (“declinazione magnetica”) in diverse parti del mondo. Le linee che uniscono i punti del pianeta aventi la stessa declinazione (“isogone”) vanno in modo irregolare dal polo nord magnetico al polo sud magnetico.

Sfortunatamente queste mappe vanno aggiornate periodicamente, perché la declinazione magnetica muta col tempo anche in uno stesso luogo; per esempio, la declinazione a Londra si spostò di 32 gradi di arco in due secoli: mentre nel 1600 era, rispetto al nord, di 8 gradi a est, seguitò poi a ruotare in senso antiorario fino a disporsi, nel 1800, a 24 gradi a ovest. In seguito ha ripreso a spostarsi in senso opposto, così che nel 1950 era di soli 8 gradi a ovest.

Anche l’inclinazione magnetica muta lentamente nel tempo in ogni luogo della terra, così che anche le mappe delle linee che uniscono punti con uguale inclinazione (“isocline”) devono essere aggiornate di continuo. Inoltre, l’intensità del campo magnetico terrestre aumenta con la latitudine: vicino ai poli magnetici è tre volte maggiore che nelle regioni equatoriali. A sua volta, questa intensità cambia continuamente, così che anche le mappe delle “isodinamiche” vanno continuamente aggiornate. Come tutto quanto riguarda il campo magnetico, anche l’intensità globale del campo è variabile. Da qualche tempo essa va diminuendo. Il campo ha perso il 15 per cento della sua intensità totale dal 1670; se tale diminuzione continuasse, l’intensità si ridurrebbe a zero verso l’anno 4000. Cosa accadrebbe poi? Continuerebbe a diminuire, subendo un’inversione, cioè presentando il polo magnetico nord nell’Antartide e quello sud nell’Artico? In altri termini, il campo magnetico terrestre è soggetto a un ciclo periodico durante il quale diminuisce, si inverte, aumenta, torna a diminuire, si inverte nuovamente, e così via?

Un metodo per rispondere a questa domanda ci è offerto dallo studio delle rocce vulcaniche. Quando la lava si raffredda, i cristalli che si formano risultano allineati con il campo magnetico. Già nel 1906 il fisico francese Bernard Brunhes aveva osservato che alcune rocce erano magnetizzate in direzione “opposta” a quella attuale del campo magnetico terrestre; tale scoperta fu quasi ignorata ai suoi tempi, perché sembrava irragionevole; oggi però la cosa è accettata in modo generale. Le rocce sono rivelatrici: esse non solo ci informano del fatto che il campo magnetico terrestre si è invertito, ma ci dicono anche che lo ha fatto molte volte: nove volte negli ultimi 4 milioni di anni, a intervalli irregolari.

La scoperta più spettacolare a questo proposito riguarda il fondale oceanico. Se è vero che roccia fusa fuoriesce attraverso il Rift Globale e si raffredda sui suoi due lati, allora, spostandosi verso est o verso ovest rispetto al Rift, si devono trovare rocce che si sono solidificate in tempi sempre più remoti. Studiando l’allineamento magnetico si trovano effettivamente, via via che ci si allontana dal Rift, fasce di opposto orientamento alternate a intervalli corrispondenti a periodi variabili fra 50 mila e 20 milioni di anni. La distribuzione di tali fasce è specularmente identica sui due lati del Rift. L’unica spiegazione razionale trovata finora è quella di ammettere tanto l’espansione del fondale marino quanto le ripetute inversioni del campo magnetico. Accertata la realtà dell’inversione rimane comunque l’enigma delle ragioni per cui essa avviene. Oltre agli spostamenti a lungo termine del campo magnetico, si verificano anche alcune lievi variazioni giornaliere: ciò fa pensare a qualche relazione con il sole. Vi sono poi dei “giorni perturbati”, in cui l’ago della bussola salta qua e là con insolita vivacità. In questi casi, si usa dire che la terra sta attraversando una “tempesta magnetica”. Le tempeste magnetiche sono identiche alle tempeste elettriche; solitamente sono accompagnate da un aumento dell’intensità delle manifestazioni aurorali – una connessione questa osservata già nel 1759 dal fisico inglese John Canton.

L'”aurora boreale” (espressione introdotta nel 1621 dal filosofo francese Pierre Gassendi) è uno splendido spettacolo, caratterizzato da mutevoli strisce di luce dei più svariati colori, che producono un effetto di una magnificenza soprannaturale. Il fenomeno corrispondente nell’Antartide viene detto “aurora australe”. Nel 1741 l’astronomo svedese Anders Celsius notò una relazione tra aurore polari e campo magnetico terrestre. Le bande luminose delle aurore sembrano seguire le linee di forza del campo magnetico terrestre, concentrandosi e diventando visibili proprio là dove tali linee di forza si infittiscono, avvicinandosi maggiormente tra loro – cioè ai poli magnetici. Durante le tempeste magnetiche, l’aurora boreale diventa visibile anche a latitudini molto più basse, come quelle di Boston e New York.

Non fu dunque difficile capire le cause dell’aurora polare. Dopo la scoperta della ionosfera, si comprese che qualcosa (presumibilmente qualche tipo di radiazione solare) forniva energia agli atomi nella parte superiore dell’atmosfera, convertendoli in ioni elettricamente carichi. Di notte gli ioni perdevano la carica e l’energia: era quest’ultima a rendersi visibile sotto forma di luce aurorale. Si trattava di una forma particolare di luminescenza atmosferica, che seguiva le linee di forza magnetiche, concentrandosi vicino ai poli magnetici, come vi era da aspettarsi da parte degli ioni, che sono elettricamente carichi. (Invece l’ordinaria luminescenza diffusa non risente del campo magnetico, perché è dovuta ad atomi privi di carica elettrica.)

IL VENTO SOLARE

Come spiegare, però, i giorni di perturbazione e le tempeste magnetiche? I sospetti si addensavano ancora una volta sul sole. A quanto pare, l’attività delle macchie solari dà origine alle tempeste magnetiche. Non è facile capire come una perturbazione che avviene a 150 milioni di chilometri di distanza possa avere un effetto sulla terra, ma le cose devono stare così, perché queste tempeste sono particolarmente comuni quando l’attività delle macchie solari è intensa.

Il primo indizio chiarificatore si presentò nel 1859, quando un astronomo inglese, Richard Christopher Carrington, osservò un punto luminoso, simile a una stella, che si accese in prossimità della superficie solare, brillò per 5 minuti e poi diminuì di intensità. Questa è la prima osservazione di un “brillamento solare” di cui si abbia notizia. Carrington suppose che una grossa meteora fosse caduta sul sole, e ritenne il fenomeno del tutto eccezionale. Tuttavia, nel 1889 George E. Hale inventò lo “spettroeliografo” che permetteva di fotografare il sole nella luce di una particolare regione dello spettro. Con questo strumento divenne facile registrare i brillamenti solari, e si vide che essi sono un fenomeno normale, collegato con le regioni in cui sono attive le macchie. Evidentemente i brillamenti solari sono eruzioni di insolita violenza, che in qualche modo chiamano in causa gli stessi fenomeni che producono le macchie solari (e pertanto ancora non si conosce la loro causa). Quando il brillamento avviene nelle vicinanze del centro del disco solare, esso si trova proprio di fronte alla terra, e tutto ciò che ne viene emesso si muove proprio in direzione della terra. E’ stato accertato che a questi brillamenti centrali seguono, dopo pochi giorni, le tempeste magnetiche sulla terra, allorché le particelle espulse dal sole raggiungono gli strati superiori dell’atmosfera terrestre. Una spiegazione di questo genere era stata proposta fin dal 1896 dal fisico norvegese Olaf Kristian Birkeland. Ormai erano state raccolte numerose prove che mostravano che di fatto la terra è immersa in un alone di particelle di incerta provenienza, che si estende fino a grandi distanze nello spazio. Si era scoperto che le onde radio provocate dai lampi viaggiano lungo le linee di forza magnetiche terrestri fino a grandi altezze. (Queste onde vennero chiamate “whistlers” [sibili], perché i ricevitori le captavano come strani rumori, simili a fischi, e furono scoperte per caso dal fisico tedesco Heinrich Barkhausen durante la prima guerra mondiale.) Le onde radio non avrebbero potuto seguire le linee di forza, in assenza di particelle cariche. Non sembrava, però, che queste particelle cariche venissero emesse dal

sole soltanto a tratti.

Nel 1931, mentre studiava la corona solare, Sydney Chapman scoprì con crescente stupore quanto essa fosse estesa. Quella che noi riusciamo a scorgere durante un’eclissi totale di sole non è che la sua parte più interna. Chapman pensò che forse le concentrazioni di particelle cariche rilevabili nelle vicinanze della terra facevano parte della corona. Allora, in un certo senso, la terra gira intorno al sole all’interno di questa sua atmosfera esterna estremamente rarefatta. Chapman tracciò un quadro della corona che si espande nello spazio verso l’esterno e si rinnova continuamente alla superficie del sole. Vi sarebbe, a partire dal sole, un continuo flusso di particelle cariche in tutte le direzioni; e sarebbero queste particelle a perturbare il campo magnetico terrestre quando lo attraversano. Questa conclusione divenne praticamente inevitabile negli anni cinquanta, grazie al lavoro dell’astrofisico tedesco Ludwig Franz Biermann. Per mezzo secolo si era ritenuto che le code delle comete, che sono sempre rivolte in direzione opposta al sole e si allungano via via che la cometa si avvicina a quest’ultimo, fossero dovute alla pressione della luce proveniente dal sole. Questa pressione della luce esiste effettivamente, ma Biermann mostrò che è di gran lunga troppo piccola per poter produrre le code delle comete; occorreva qualcosa capace di esercitare un’azione più efficace, e questo qualcosa difficilmente avrebbe potuto essere altro che un flusso di particelle cariche. Il fisico americano Eugene Norman Parker portò altri argomenti a favore di un’emissione costante di particelle, che si intensificasse saltuariamente al momento dei brillamenti solari, e nel 1958 chiamò questo effetto “vento solare”. L’esistenza di tale vento solare fu definitivamente dimostrata dai satelliti sovietici “Lunik Primo” e “Lunik Secondo”, che giunsero in vicinanza della luna nel 1959 e nel 1960, e dalla sonda planetaria americana “Mariner Secondo”, che nel 1962 passò vicino a Venere.